Robot之VideoMimic:《Visual Imitation Enables Contextual Humanoid Control》翻译与解读

Robot之VideoMimic:《Visual Imitation Enables Contextual Humanoid Control》翻译与解读

导读:这篇论文介绍了VIDEOMIMIC,一个基于视觉模仿的真实到模拟到真实流水线,用于训练人形机器人执行上下文相关的全身动作。该方法通过分析日常人类动作视频,联合重建人类和环境,学习出能够根据环境和全局指令调整的机器人控制策略。实验表明,VIDEOMIMIC能够使人形机器人熟练掌握爬楼梯、坐立等复杂技能,展现了其在提升机器人环境适应性和泛化能力方面的潜力。

>> 背景痛点:目前,教导人形机器人执行复杂任务,例如爬楼梯、坐在椅子上等,需要耗费大量的时间和精力进行编程和训练。 传统的机器人控制方法往往难以处理环境变化和任务的多样性,缺乏对环境上下文的理解。 现有方法难以实现机器人对环境的灵活适应和对任务的泛化能力。

>> 具体的解决方案:论文提出了一种名为 VIDEOMIMIC 的真实到模拟到真实的流水线方法,该方法利用日常视频数据来学习人形机器人的控制策略。 它通过挖掘日常视频,联合重建人类和环境,生成用于执行相应技能的人形机器人的全身控制策略。

>> 核心思路步骤:VIDEOMIMIC 的核心思路包含以下步骤:

● 数据采集: 收集日常生活中的人类执行各种动作的视频数据,例如爬楼梯、坐在椅子上等。

● 环境和人类的联合重建: 对视频数据进行处理,同时重建视频中的人类动作和环境场景的三维模型。

● 策略学习: 基于重建的模型和人类动作数据,学习一个能够控制人形机器人执行相应动作的策略。该策略能够根据环境和全局根命令进行调节。

● 模拟到真实: 将学习到的策略先在模拟环境中进行测试和优化,然后再转移到真实的人形机器人上进行实验。

>> 优势:VIDEOMIMIC 的主要优势在于:

● 简单易行: 只需要提供日常生活中拍摄的人类动作视频,无需复杂的编程或手动标注。

● 可扩展性强: 能够处理各种不同的环境和任务,具有良好的可扩展性。

● 鲁棒性好: 学习到的策略能够在真实环境中稳定可靠地执行。

● 上下文感知: 策略能够根据环境和全局根命令进行调节,实现上下文感知的控制。

>> 结论和观点:

● 论文通过在真实的人形机器人上进行实验,展示了 VIDEOMIMIC 的有效性。 它能够让机器人执行各种复杂的全身动作,例如爬楼梯、坐在椅子上等,所有这些都来自于单个策略,并且能够根据环境和全局根命令进行调节。

● VIDEOMIMIC 为教导人形机器人在不同的真实世界环境中运行提供了一种可扩展的途径。

● 该研究表明,通过视觉模仿学习,可以有效地将人类的技能转移到人形机器人上,从而实现更灵活、更智能的机器人控制。

目录

《Visual Imitation Enables Contextual Humanoid Control》翻译与解读

Abstract

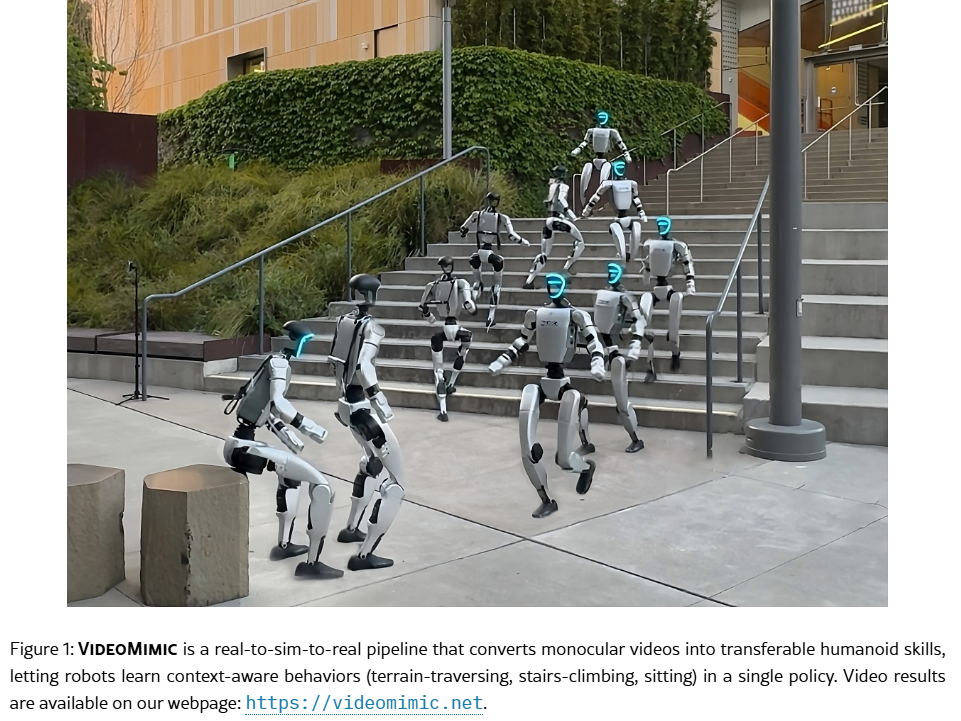

Figure 1:VideoMimic is a real-to-sim-to-real pipeline that converts monocular videos into transferable humanoid skills, letting robots learn context-aware behaviors (terrain-traversing, stairs-climbing, sitting) in a single policy. Video results are available on our webpage: https://videomimic.net.图 1:VideoMimic 是一个从真实到模拟再到真实的流程,它能将单目视频转换为可迁移的人形技能,让机器人在单一策略中学习情境感知行为(地形穿越、爬楼梯、坐下)。视频结果可在我们的网页上查看:https://videomimic.net 。

1、Introduction

Conclusion

《Visual Imitation Enables Contextual Humanoid Control》翻译与解读

| 地址 | 论文地址:[2505.03729] Visual Imitation Enables Contextual Humanoid Control |

| 时间 | 2025年5月6日 最新为2025年5月7日 |

| 作者 | UC Berkeley |

Abstract

| How can we teach humanoids to climb staircases and sit on chairs using the surrounding environment context? Arguably, the simplest way is to just show them—casually capture a human motion video and feed it to humanoids. We introduce VideoMimic, a real-to-sim-to-real pipeline that mines everyday videos, jointly reconstructs the humans and the environment, and produces whole-body control policies for humanoid robots that perform the corresponding skills. We demonstrate the results of our pipeline on real humanoid robots, showing robust, repeatable contextual control such as staircase ascents and descents, sitting and standing from chairs and benches, as well as other dynamic whole-body skills—all from a single policy, conditioned on the environment and global root commands. VideoMimic offers a scalable path towards teaching humanoids to operate in diverse real-world environments. | 我们如何利用周围环境的背景信息来教会类人机器人爬楼梯和坐在椅子上?可以说,最简单的方法就是直接展示给他们看——随意拍摄一段人类动作视频,然后将其输入给类人机器人。我们推出了 VideoMimic,这是一种从真实到模拟再到真实的流程,它挖掘日常视频,同时重建人类和环境,并为类人机器人生成执行相应技能的全身控制策略。我们在真实的类人机器人上展示了我们流程的结果,展示了稳健、可重复的环境相关控制,例如上下楼梯、从椅子和长凳上坐起和站起,以及其他动态全身技能——所有这些都来自一个策略,该策略以环境和全局根命令为条件。VideoMimic 为教会类人机器人在各种真实世界环境中操作提供了一条可扩展的途径。 |

Figure 1:VideoMimic is a real-to-sim-to-real pipeline that converts monocular videos into transferable humanoid skills, letting robots learn context-aware behaviors (terrain-traversing, stairs-climbing, sitting) in a single policy. Video results are available on our webpage: https://videomimic.net.图 1:VideoMimic 是一个从真实到模拟再到真实的流程,它能将单目视频转换为可迁移的人形技能,让机器人在单一策略中学习情境感知行为(地形穿越、爬楼梯、坐下)。视频结果可在我们的网页上查看:https://videomimic.net

1、Introduction

| How do we learn to interact with the world around us—like sitting on a chair or climbing a staircase? We watch others perform these actions, try them ourselves, and gradually build up the skill. Over time, we can handle new chairs and staircases, even if we have not seen those exact ones before. If humanoid robots could learn in this way—by observing everyday videos—they could acquire diverse contextual whole-body skills without relying on hand-tuned rewards or motion-capture data for each new behavior and environment. We refer to this ability to execute environment-appropriate actions as contextual control. We introduce VideoMimic, a real-to-sim-to-real pipeline that turns monocular videos—such as casual smartphone captures—into transferable skills for humanoids. From these videos, we jointly recover the 4D human-scene geometry, retarget the motion to a humanoid, and train an RL policy to track the reference trajectories. We then distill the policy into a single unified policy that observes only proprioception, a local height-map, and the desired root direction. This distilled policy outputs low-level motor actions conditioned on the terrain and body state, allowing it to execute appropriate behaviors—such as stepping, climbing, or sitting—across unseen environments without explicit task labels or skill selection. | 我们是如何学会与周围世界互动的,比如坐在椅子上或爬楼梯?我们观察他人做这些动作,自己尝试,然后逐渐掌握技能。随着时间的推移,我们能够应对新的椅子和楼梯,即便之前从未见过那些具体的物件。如果类人机器人能够通过这种方式学习——观察日常视频——它们就能在不依赖于为每种新行为和环境手动调整奖励或动作捕捉数据的情况下,获得各种情境下的全身技能。我们将这种执行适合环境动作的能力称为情境控制。 我们推出了 VideoMimic,这是一种从真实到模拟再到真实的流水线,能够将单目视频(例如随意用智能手机拍摄的视频)转化为适用于仿人机器人的可迁移技能。从这些视频中,我们共同恢复出 4D 人体场景几何结构,将动作重新定位到仿人机器人上,并训练一个强化学习策略来跟踪参考轨迹。然后,我们将该策略提炼为一个单一的统一策略,该策略仅观察本体感觉、局部高度图和期望的根方向。这个提炼后的策略根据地形和身体状态输出低级运动动作,使其能够在未见过的环境中执行适当的行为,例如行走、攀爬或坐下,而无需明确的任务标签或技能选择。 |

| We develop a perception module that reconstructs 3D human motion from a monocular RGB video, along with aligned scene point clouds in the world coordinate frame. We convert the point clouds into meshes and align them with gravity to ensure compatibility with physics simulators. The global motion and local poses are retargeted to a humanoid with constraints that ensure physical plausibility, accounting for the embodiment gap. The mesh and retargeted data seed a goal-conditioned DeepMimic [1]-style reinforcement-learning phase in simulation: we warm-start on MoCap data, then train a single policy to track motions from multiple videos in their respective height-mapped environments while randomizing mass, friction, latency, and sensor noise for robustness. Once our tracking policy is trained, we distill it using DAgger [2] to a policy that operates without conditioning on target joint angles. The new policy observes proprioception, an 11 × 11 height-map patch centered on the torso, and the vector to the goal in the robot’s local reference frame. PPO fine-tuning under this reduced observation set yields a generalist controller that, given height-map and root direction at test time, selects and smoothly executes context-appropriate actions such as stepping, climbing, or sitting. In particular, every step of our policy relies only on observations available at real-world deployment, making it immediately runnable on real hardware. Our approach bridges 4D video reconstruction and robot skill learning in a single, data-driven loop. Unlike earlier work that recovers only the person or the scene in isolation, we jointly reconstruct both at a physically meaningful scale and represent them as meshes and motion trajectories suitable for physics-based policy learning. We train our approach on 123 monocular RGB videos, which will be released. We validate the approach through deployment on a real Unitree G1 robot, which shows generalized humanoid motor skills in the context of surrounding environments, even on unseen environments. We will release the reconstruction code, policy training framework, and the video dataset to facilitate future research. | 我们开发了一个感知模块,该模块能够从单目 RGB 视频中重建 3D 人体运动,并结合在世界坐标系中的对齐场景点云。我们将点云转换为网格,并使其与重力对齐,以确保与物理模拟器兼容。全局运动和局部姿态被重新定位到一个类人形体上,并施加约束以确保物理合理性,同时考虑了实体差距。网格和重新定位的数据为模拟中的目标条件式 DeepMimic [1] 风格的强化学习阶段提供了种子:我们从动作捕捉数据开始预热,然后训练一个单一策略,使其在多个视频各自的高度图环境中跟踪运动,同时随机化质量、摩擦力、延迟和传感器噪声以增强鲁棒性。一旦我们的跟踪策略训练完成,我们使用 DAgger [2] 对其进行蒸馏,得到一个无需基于目标关节角度进行条件设定的策略。新策略观察本体感觉、以躯干为中心的 11×11 高度图补丁以及机器人本地参考系中到目标的向量。在这一缩减的观测集下对 PPO 进行微调,可得到一个通用控制器,该控制器在测试时,根据高度图和根部方向,选择并流畅执行诸如行走、攀爬或坐下等符合情境的动作。特别是,我们策略的每一步都仅依赖于在实际部署中可用的观测值,因此可立即在真实硬件上运行。 我们的方法在单一的数据驱动循环中将 4D 视频重建与机器人技能学习相结合。与早期仅单独恢复人物或场景的工作不同,我们以具有物理意义的尺度共同重建两者,并将其表示为适合基于物理的策略学习的网格和运动轨迹。我们在 123 个单目 RGB 视频上训练了我们的方法,这些视频将被发布。我们通过在真实的 Unitree G1 机器人上部署来验证该方法,该机器人在周围环境的背景下展示了通用的人形运动技能,甚至在未见过的环境中也是如此。我们将发布重建代码、策略训练框架和视频数据集,以促进未来的研究。 |

Conclusion

| We introduced VideoMimic, a real-to-sim-to-real pipeline that converts everyday human videos into environment-conditioned control policies for humanoids. The system (i) reconstructs humans and surrounding geometry from monocular clips, (ii) retargets the motion to a kinematically feasible humanoid, and (iii) uses the recovered scene as task terrain for dynamics-aware RL. The result is a single policy that delivers robust, repeatable contextual control—e.g., stair ascents/descents and chair sit-stand—all driven only by the environment geometry and a root direction command. VideoMimic offers a scalable path for teaching humanoids contextual skills directly from videos. We expect future work to extend the system to richer human–environment interactions, multi-modal sensor-based context learning, and multi-agent behavior modeling, among other directions. | 我们推出了 VideoMimic,这是一种从真实到模拟再到真实的流水线,能够将日常的人类视频转换为适用于仿人机器人的环境条件控制策略。该系统(i)从单目视频片段中重建人类和周围环境的几何形状,(ii)将动作重新定位到运动学上可行的仿人机器人上,(iii)将恢复的场景作为任务地形用于动态感知强化学习。其结果是一个单一的策略,能够提供稳健、可重复的上下文控制,例如上下楼梯和坐立,仅由环境几何形状和根方向指令驱动。VideoMimic 为直接从视频中教授仿人机器人上下文技能提供了一条可扩展的途径。我们期望未来的工作将该系统扩展到更丰富的人类与环境交互、基于多模态传感器的上下文学习以及多智能体行为建模等方面。 |

相关文章:

Robot之VideoMimic:《Visual Imitation Enables Contextual Humanoid Control》翻译与解读

Robot之VideoMimic:《Visual Imitation Enables Contextual Humanoid Control》翻译与解读 导读:这篇论文介绍了VIDEOMIMIC,一个基于视觉模仿的真实到模拟到真实流水线,用于训练人形机器人执行上下文相关的全身动作。该方法通过分…...

【Java学习日记34】:this关键字和成员变量

为什么不需要加 this? 作用域规则: Java编译器在查找变量时遵循“就近原则”。 先在当前方法内查找局部变量或参数。 若找不到,则去类的成员变量中查找。 getName() 的上下文: 该方法没有参数或局部变量名为 name,因…...

包名查看器APP:高效管理手机应用的实用工具

包名查看器APP是一款功能强大的文件查看软件,专为安卓用户设计,能够帮助用户快速了解手机上安装和未安装的APK包信息。作为酷安首发的APK信息查看工具,它提供了比系统设置更详细的信息,如版本号、包名、MD5等,帮助用户…...

左右括号的最小处理次数

1、题目描述 多多君在处理一个由左结号(和右语号)组成的字符串,多多君每次处理时可以顺序读取一个字符或者一个有效括号子串,求问多多的最小处理次数。 输入描述: 第一行为一个整数N,表示字符串长度(1<…...

22.第二阶段x64游戏实战-分析周围对象类型

免责声明:内容仅供学习参考,请合法利用知识,禁止进行违法犯罪活动! 本次游戏没法给 内容参考于:微尘网络安全 上一个内容:21.第二阶段x64游戏实战-分析采集物偏移 上一个内容里发现采集物的名字通过我们…...

【C/C++】无符号调试:GDB解栈实战指南

文章目录 无符号调试:GDB解栈实战指南1 生成并加载 Core Dump2 查看原始堆栈信息(地址形式)3 确认加载的共享库地址范围4 手动转换地址为函数名5 反汇编关键代码段6 加载外部符号文件(如有)7 结合系统库文档分析8 示例…...

梦熊联盟:202505基础语法-题解

202505基础语法-题解 T1 - 九的倍数 解法: 对于 9 的倍数,只需要判定其各位的数码和是否为 9 的倍数即可。 例如判断一个数是不是 9 的倍数,只要判断其各位数字之和是不是 9 的倍数,因为一个数能被 9 整除当且仅当它的各位数字之和…...

——内部类)

Java SE(11)——内部类

1.内部类 定义:Java中的内部类(Inner Class)是指在一个类的内部定义的类。 使用场景:当一个类的内部,存在一个部分需要完成的结构进行描述,而该内部结构只为外部类提供服务,那么这个内部结构就可以使用内部类ÿ…...

优化审核模块响应时间从8s降至1.2s的数据库解决方案

优化审核模块响应时间从8s降至1.2s的数据库解决方案 要优化审核模块的数据库性能,需要从多个层面进行分析和优化。以下是具体的SQL语句设计和优化方案: 1. 分析当前性能瓶颈 首先需要找出慢查询: -- 查看慢查询日志中的审核模块相关查询 …...

YOLO-World:基于YOLOv8的开放词汇目标检测

文章目录 前言1、出发点2、方法2.1.TextEncoder2.2.ReparmVLPAN2.3.输出头 3、实验3.1.数据集3.2.LVIS测试集 总结 前言 本文介绍一篇来自腾讯的开放词汇检测工作,发表自CVPR2024,论文链接,开源地址。 1、出发点 GroundingDINO在开放词汇检测…...

NX989NY104美光科技芯片NY109NY113

NX989NY104美光科技芯片NY109NY113 存储市场新势力:美光科技的崛起与技术突围 在半导体行业波澜壮阔的浪潮中,美光科技宛如一颗璀璨的明珠,以其独特的技术实力和敏锐的市场洞察力,在存储领域占据了重要的一席之地。尤其是其旗下…...

LabVIEW的PID参数自适应控制

在工业控制领域,PID 控制凭借结构简单、稳定性好、工作可靠等优点被广泛应用。然而,传统固定参数的 PID 控制在面对复杂多变的工况时,控制效果往往难以达到最优。基于 LabVIEW 实现 PID 控制根据情况选择参数(即参数自适应调整&am…...

Quartus与Modelsim-Altera使用手册

目录 文章内容: 视频内容: Quartus: ModelSim: 顶层设计与子模块: 只是对所查阅的相关文章的总结与视频总结 文章内容: 这篇对基础操作很详细: 一、Quartus II软件的使用_quartus2软件上…...

:实际案例)

设计模式之工厂模式(二):实际案例

设计模式之工厂模式(一) 在阅读Qt网络部分源码时候,发现在某处运用了工厂模式,而且编程技巧也用的好,于是就想分享出来,供大家参考,理解的不对的地方请多多指点。 以下是我整理出来的类图: 关键说明&#x…...

数据可视化大屏——智慧社区内网比对平台

综述分析: 智慧社区内网数据比对信息系统 这段代码实现了一个智慧社区内网数据比对信息系统的前端界面,采用三栏式布局展示各类社区安全相关数据。界面主要由左侧数据统计、中间地图展示和右侧数据分析三部分组成,使用了多种图表可视化技术…...

Spark任务调度流程详解

1. 核心调度组件 DAGScheduler:负责将Job拆分为Stage,处理Stage间的依赖关系。 TaskScheduler:将Task分配到Executor,监控任务执行。 SchedulerBackend:与集群管理器(如YARN、K8s)通信&#x…...

LeetCode 215题解 | 数组中的第K个最大元素

数组中的第K个最大元素 一、题目链接二、题目三、算法原理四、编写代码 一、题目链接 数组中的第K个最大元素 二、题目 三、算法原理 法一:排序 法二:优先级队列(堆) 重点看法二: 默认建大堆,意味着以…...

探秘 Cursor 核心:解锁系统提示词的进阶之路

在 AI 编程领域,Cursor 无疑是一颗耀眼的明星,其母公司 Anysphere 在短短三个月内,估值从 25 亿美元狂飙至 100 亿美元,这样的发展速度令人咋舌。而 Cursor 强大功能背后的核心 —— 系统提示词,始终笼罩着一层神秘的面…...

ElasticSearch入门详解

1.ElasticSearch 1.1 ElasticSearch(简称es) Elasticsearch是用Java开发并且是当前最流行的开源的企业级搜索引擎。 能够达到实时搜索,稳定,可靠,快速,安装使用方便。 客户端支持Java、.NET(C#)、PHP、Py…...

【计算机网络01】 网络组成与三种交换方式

【参考资料】 《自顶向下的计算机网络第八版》湖科大计算机网络(b站)王道考研(b站) 文章目录 一、网络基础概念解析1.1 网络、互联网与因特网 二、因特网发展三阶段(了解)三、ISP3.1 ISP基本概念3.2 基于I…...

计算机网络——以太网交换机

目录 交换机的作用 以太网交换机的自学习功能 因为以太网交换机有自学习功能,所以以太网交换机支持即插即用 交换机的作用 它工作在数据链路层,为结点转发帧,并且可以根据一个帧的目的MAC地址去进行相应的转发,以及交换机的每…...

机器视觉开发教程——C#如何封装海康工业相机SDK调用OpenCV/YOLO/VisionPro/Halcon算法

目录 引言前期准备Step1 创建工程Step2 创建接口2.1定义操作相机实例接口方法2.2定义设置相机参数接口方法(部分) Step3 创建基类3.1定义操作相机实例&&设置相机参数的抽象层3.2定义操作相机实例&&设置相机参数的公用方法1.获取当前帧图…...

c++STL-string的模拟实现

cSTL-string的模拟实现 string的模拟实现string的模拟线性表的实现构造函数析构函数获取长度(size)和获取容量(capacity)访问 [] 和c_str迭代器(iterator)交换swap拷贝构造函数赋值重载(&#x…...

HTTP 和 WebSocket 的区别

✅ 一、定义对比 协议简要定义HTTP一种基于请求-响应模式的、无状态的应用层协议,通常用于客户端与服务器之间的数据通信。WebSocket一种全双工通信协议,可以在客户端和服务器之间建立持久连接,实现实时、低延迟的数据传输。 ✅ 二、通信方式…...

)

【Tools】Visual Studio使用经验介绍(包括基本功能、远程调试、引入第三方库等等)

这里写目录标题 1. VS基本使用1.1. 快捷键1.2. 查看变量地址1.3. 查看代码汇编1.4. visual studio 热重载功能的使用1.5. vs远程服务器调试1.6. 引入第三方库VLD1.7. release debug模式 1. VS基本使用 1.1. 快捷键 ctrl c :复制光标所在行 注意:只需要光标在这…...

一周内学完计算机网络课程之二:计算机网络物理层的理解

消失人口回归,重新开始学习新知识。再次伟大。 物理层详解 需要理解的几个概念: 曼彻斯特编码、差分曼彻斯特编码 码元:构成信号的基本单元 调制: 通信中的调制是一种将原始信号(如音频、视频、数据等)转…...

Python OpenCV性能优化与部署实战指南

在计算机视觉领域,OpenCV作为开源视觉库的标杆,其性能表现直接影响着从工业检测到AI模型推理的各类应用场景。本文结合最新技术趋势与生产实践,系统性梳理Python环境下OpenCV的性能优化策略与部署方案。 一、性能优化核心技术矩阵 1.1 内存…...

深度解析:可视化如何重塑销售策略制定与执行

为什么你的销售策略总是“听起来挺对,做起来却没用”? 你有没有遇到过这样的情况: 销售团队天天跑客户,但业绩还是上不去;市场部说数据在增长,销售部却觉得“根本没转化”;高层开会时信心满满…...

opencv关键点检测

python 使用opencv进行图片关键点检测 功能: 在一张图片中裁剪出一块小图 使用cv2中 cv2.SIFT_create() SIFT检测器检测关键点 匹配原图和小图的关键点 import cv2 import numpy as np # 读取图像 img1 cv2.imread(rE:\234947.jpg, cv2.IMREAD_GRAYSCALE) img…...

C#游戏开发中的注意事项

目录 一、性能优化:提升游戏运行效率 1. 避免不必要的循环和迭代 2. 减少字符串拼接 3. 利用Unity的生命周期函数 4. 使用对象池(Object Pooling) 二、内存管理:避免内存泄漏和资源浪费 1. 及时释放非托管资源 2. 避免空引用异常 3. 合理使用引用类型和值类型 4. …...

MySQL的锁

锁 概述:锁是计算机协调多个线程或进程并发访问某一资源的机制。如何保证数据库中并发的一致性,有效性,这就是锁的作用。 分类: 全局锁 对数据库实例加锁,加锁之后,处于只读状态,后续的DML语句…...

学习黑客5 分钟小白弄懂Windows Desktop GUI

5 分钟小白弄懂Windows Desktop GUI 🖥️ 大家好!今天我们将深入浅出地探索Windows桌面图形用户界面(GUI)——这是我们每天与计算机交互的"门面"。无论你是刚开始接触计算机,还是想在TryHackMe等平台上提升安全技能,理…...

机器人运动控制原理浅析-UC Berkeley超视觉模态模型

加州伯克利发布的超视觉多感知模态融合(FuSe, Fuse Heterogeneous Sensory Data)模型,基于视觉、触觉、听觉、本体及语言等模态,利用自然语言跨模态对齐(Cross-Modal Grounding)优调视觉语言动作等通用模型,提高模型任务成功率。 总体框架 …...

【计算机网络】网络IP层

📚 博主的专栏 🐧 Linux | 🖥️ C | 📊 数据结构 | 💡C 算法 | 🅒 C 语言 | 🌐 计算机网络 上篇文章:传输层协议TCP 下篇文章:数据链路层 文章摘要࿱…...

Nginx重写功能

目录 一 . 简介 二. if指令 2.1基本语法 2.2 举例说明 2.3 配置实例 三. return 3.1 基本语法 3.2 配置实例 四. set指令 4.1 基本语法 4.2 举例说明 4.3 配置实例 五.break指令 5.1 作用 5.2 举例说明 5.3 配置实例 六.rewrite指令 6.1 基本语法 6.2 配…...

2025-05-11 项目绩效域记忆逻辑管理

好的,我们可以用一个故事来帮助记忆这些规划绩效域的要素,同时通过逻辑关系来串联它们。以下是一个故事化的版本: 《项目管理的奇幻之旅》 在一个遥远的王国里,有一个勇敢的项目经理名叫小K。小K被国王赋予了一个艰巨的任务&…...

全模态具身智能:从 VLM 到 MLLM

写在前面 人工智能的感知边界正在以前所未有的速度扩展。最初,我们惊叹于大型语言模型(LLM)对文本的深刻理解和流畅生成。很快,视觉语言模型(Vision-Language Models, VLM) 登场,让 AI 第一次真正“看见”了世界,能够理解图像内容并将其与语言关联,实现了“看图说话”…...

C++入门小馆: 二叉搜索树

嘿,各位技术潮人!好久不见甚是想念。生活就像一场奇妙冒险,而编程就是那把超酷的万能钥匙。此刻,阳光洒在键盘上,灵感在指尖跳跃,让我们抛开一切束缚,给平淡日子加点料,注入满满的pa…...

C++.IP协议通信

C++IP协议通信 1. TCP协议通信1.1 服务端实现创建套接字绑定地址监听连接接受连接数据传输关闭连接1.2 客户端实现创建套接字连接服务器数据传输关闭连接1.3 示例代码服务端代码示例客户端代码示例绑定地址接收数据发送数据关闭套接字2.2 客户端实现创建套接字发送数据接收数据…...

虚幻引擎5-Unreal Engine笔记之UE编辑器退出时的保存弹框

虚幻引擎5-Unreal Engine笔记之UE编辑器退出时的保存弹框 code review! 文章目录 虚幻引擎5-Unreal Engine笔记之UE编辑器退出时的保存弹框1. 退出编辑器时弹出的“Save Content”窗口2. File 菜单中的保存选项3. 区别总结 1. 退出编辑器时弹出的“Save Content”窗口 退出时…...

【KEIL】更新AC6编译器

看过部分的文章,Arm Compiler 6(AC6)编译器,相比AC5在编译速度和代码优化上提升了。因此,笔者决定升级到AC6的最新版本。可以更新keil5到最新版本,上面集成AC6编译器的版本,与最新版相差不远。假…...

Mosquitto MQTT库实战指南

目录 1. MQTT协议简介2. Mosquitto概述3. 开源MQTT实现对比4. 为什么选择Mosquitto5. Mosquitto的交叉编译6. MQTT发布订阅实战7. 进阶应用与最佳实践8. 总结 1. MQTT协议简介 MQTT(Message Queuing Telemetry Transport)是一种基于发布/订阅模式的轻…...

C语音学习---函数指针

目录 1. 函数指针解析 2. 自定义实现(函数指针赋值) 利用下面一段例子来解析: int (*set_slave)(modbus_t *ctx, int slave); 1. 函数指针解析 set_slave 是一个 函数指针,指向一个函数。 该函数接受两个参数: mo…...

04.three官方示例+编辑器+AI快速学习webgl_animation_skinning_additive_blending

本实例主要讲解内容 这个示例展示了Three.js中**骨骼动画的叠加混合(Additive Animation Blending)**技术。通过加载一个机器人模型,演示了如何在基础动画(如站立、行走、跑步)之上叠加额外的动画效果(如潜行姿态、悲伤表情、点头同意等),实现更丰富的角…...

WSL配置docker启动nacos容器load derby-schema.sql error.问题解决方案

nacos配置问题 问题再现查看错误logsQWEN的解答不挂载/data结论 问题再现 本来想要本地跑一下nacos,之前都是直接在Linux环境下面,现在就使用windows的wsl跑一下nacos,之前是需要先配置/conf文件下面的porperties文件以及构建对应的nacos-config数据库。所以我使用…...

游戏引擎学习第272天:显式移动转换

回顾并为今天的内容铺垫背景 我们刚开始为游戏主角编写一些程序逻辑,因为我们之前已经完成了大部分引擎方面的开发,现在可以专注在角色身上。这个角色的移动方式会有些特别,与大多数游戏角色的运动机制不太一样。我们当前正在实现的控制方式…...

AVL树解析

插入操作 // 插入操作 bool insert(const pair<K, V>& kv) {// 若树为空,直接构造,new一个if (_root nullptr) {_root new Node(kv);return true;}// 用于遍历树的当前节点Node* cur _root;// 用于记录当前节点的父节点Node* parent n…...

vue 中的数据代理

在 Vue 中,数据代理(Data Proxy) 是 Vue 实现 MVVM 模式 的关键技术之一。Vue 使用数据代理让你可以通过 this.message 访问 data.message,而不需要写 this.data.message —— 这大大简化了模板和逻辑代码。 我们来深入理解它的本…...

Linux共享内存深度解析:从内核机制到云原生应用

引言:超越进程边界的内存魔术 在Linux系统的进程间通信(IPC)领域,共享内存(Shared Memory)如同魔法镜子般的存在——不同进程透过它看到相同的内存镜像。这种机制摒弃了数据拷贝,直击性能瓶颈&…...

Vue Router全局拦截

Vue Router全局拦截全攻略 一、为什么需要全局拦截? 最近在开发后台管理系统时,突然发现所有页面都需要登录才能访问。如果每个页面都手动检查登录状态,那代码简直要写成意大利面条了。这时候,Vue Router的全局拦截功能就像个贴…...