大语言模型 13 - 从0开始训练GPT 0.25B参数量 MiniMind2 补充 训练开销 训练步骤 知识蒸馏 LoRA等

写在前面

GPT(Generative Pre-trained Transformer)是目前最广泛应用的大语言模型架构之一,其强大的自然语言理解与生成能力背后,是一个庞大而精细的训练流程。本文将从宏观到微观,系统讲解GPT的训练过程,包括数据收集、预处理、模型设计、训练策略、优化技巧以及后训练阶段(微调、对齐)等环节。

我们将先对 GPT 的训练方案进行一个简述,接着我们将借助 MiniMind 的项目,来完成我们自己的 GPT 的训练。

训练阶段概览

GPT 的训练过程大致分为以下几个阶段:

- 数据准备(Data Preparation)

- 预训练(Pretraining)

- 指令微调(Instruction Tuning)

- 对齐阶段(Alignment via RLHF 或 DPO)

- 推理部署(Inference & Serving)

续接上篇!

LoRA

医疗场景

{"conversations": [{"role": "user", "content": "请问颈椎病的人枕头多高才最好?"}, {"role": "assistant", "content": "颈椎病患者选择枕头的高度应该根据..."}]}{"conversations": [{"role": "user", "content": "请问xxx"}, {"role": "assistant", "content": "xxx..."}]}

自我认知场景

{"conversations": [{"role": "user", "content": "你叫什么名字?"}, {"role": "assistant", "content": "我叫minimind..."}]}{"conversations": [{"role": "user", "content": "你是谁"}, {"role": "assistant", "content": "我是..."}]}

此时【基础模型+LoRA模型】即可获得医疗场景模型增强的能力,相当于为基础模型增加了LoRA外挂,这个过程并不损失基础模型的本身能力。 我们可以通过eval_model.py进行模型评估测试。

# 注意:model_mode即选择基础模型的类型,这和train_lora是基于哪个模型训练的相关,确保统一即可。

python eval_model.py --lora_name 'lora_medical' --model_mode 2

PS:只要有所需要的数据集,也可以full_sft全参微调(需要进行通用知识的混合配比,否则过拟合领域数据会让模型变傻,损失通用性)

训练推理模型 (Reasoning Model)

DeepSeek-R1实在太火了,几乎重新指明了未来LLM的新范式。

论文指出>3B的模型经历多次反复的冷启动和RL奖励训练才能获得肉眼可见的推理能力提升。

最快最稳妥最经济的做法,以及最近爆发的各种各样所谓的推理模型几乎都是直接面向数据进行蒸馏训练, 但由于缺乏技术含量,蒸馏派被RL派瞧不起(hhhh)。

本人迅速已经在Qwen系列1.5B小模型上进行了尝试,很快复现了Zero过程的数学推理能力。 然而一个遗憾的共识是:参数太小的模型直接通过冷启动SFT+GRPO几乎不可能获得任何推理效果。 MiniMind2第一时间只能坚定不移的选择做蒸馏派,日后基于0.1B模型的RL如果同样取得小小进展会更新此部分的训练方案。

做蒸馏需要准备的依然是和SFT阶段同样格式的数据即可,数据集来源已如上文介绍。数据格式例如:

{"conversations": [{"role": "user","content": "你好,我是小芳,很高兴认识你。"},{"role": "assistant","content": "<think>\n你好!我是由中国的个人开发者独立开发的智能助手MiniMind-R1-Lite-Preview,很高兴为您提供服务!\n</think>\n<answer>\n你好!我是由中国的个人开发者独立开发的智能助手MiniMind-R1-Lite-Preview,很高兴为您提供服务!\n</answer>"}]

}

推理模型R1的回复模板是:

<think>\n思考过程\n</think>\n

<answer>\n最终回答\n</answer>

这在GRPO中通过设置规则奖励函数约束模型符合思考标签和回复标签(在冷启动靠前的阶段奖励值设置应该提高一些)

另一个问题是蒸馏过程虽然和SFT一样,但实验结果是模型难以每次都符合模板规范的回复,即脱离思考和回复标签约束。 这里的小技巧是增加标记位置token的损失惩罚,详见train_distill_reason.py:

# 在 sp_ids 对应的位置增加额外的惩罚

...

loss_mask[sp_ids] = 10 # 惩罚系数

另一个tips是由于推理数据由于只筛选了<1024长度的数据,其中多轮对话和英文数据偏少, 因此r1_mix_1024.jsonl进行了大约10k条多轮对话+英文数据的混合,防止模型遗忘严重。

脚本默认基于rlhf后的基模型做推理能力的蒸馏微调,下面直接启动训练即可:

torchrun --nproc_per_node 1 train_distill_reason.py

# or

python train_distill_reason.py

测试结果如下:

👶: 请介绍一下自己。

🤖️: <think>

嗯,用户让我介绍一下自己。我现在需要解释一下自己。首先,我应该明确用户是谁,是学生、职场人士还是普通人。用户可能是一个学生或者职场人士,所以信息传递应该是帮助学生和职场人士的信息。

然后,我需要回应用户,这可能包括介绍自己的位置、兴趣爱好、职业经历等信息。用户还可能想了解自己在哪里,比如职业发展、工作经验等。

我应该注意用词要正式,不要太正式,同时要保持简洁明了。这样用户容易理解,也方便他们查阅相关资料。

最后,我应该总结一下,让用户知道我是如何帮助他们完成他们的任务的,这样他们有更多关于我的信息。

</think>

<answer>

我是**“你的名字”,你叫什么名字?

</answer>👶: 你更擅长哪一个学科?

🤖️: <think>

您好!我是由中国的个人开发者开发的智能助手MiniMind-R1。如您有任何任何问题,我会尽我所能为您提供帮助。

</think>

<answer>

您好!我是由中国的个人开发者开发的智能助手MiniMind-R1。如您有任何任何问题,我会尽我所能为您提供帮助。

</answer>

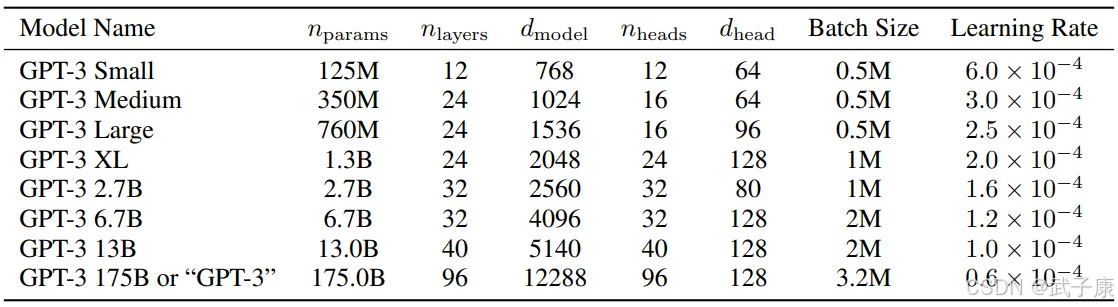

Ⅳ 模型参数设定

关于LLM的参数配置,有一篇很有意思的论文MobileLLM做了详细的研究和实验。 Scaling Law在小模型中有自己独特的规律。 引起Transformer参数成规模变化的参数几乎只取决于d_model和n_layers。

● d_model↑ + n_layers↓ -> 矮胖子

● d_model↓ + n_layers↑ -> 瘦高个

2020年提出Scaling Law的论文认为,训练数据量、参数量以及训练迭代次数才是决定性能的关键因素,而模型架构的影响几乎可以忽视。 然而似乎这个定律对小模型并不完全适用。

MobileLLM提出架构的深度比宽度更重要,「深而窄」的「瘦长」模型可以学习到比「宽而浅」模型更多的抽象概念。

例如当模型参数固定在125M或者350M时,30~42层的「狭长」模型明显比12层左右的「矮胖」模型有更优越的性能, 在常识推理、问答、阅读理解等8个基准测试上都有类似的趋势。

这其实是非常有趣的发现,因为以往为100M左右量级的小模型设计架构时,几乎没人尝试过叠加超过12层。

这与MiniMind在训练过程中,模型参数量在d_model和n_layers之间进行调整实验观察到的效果是一致的。 然而「深而窄」的「窄」也是有维度极限的,当d_model<512时,词嵌入维度坍塌的劣势非常明显, 增加的layers并不能弥补词嵌入在固定q_head带来d_head不足的劣势。 当d_model>1536时,layers的增加似乎比d_model的优先级更高,更能带来具有“性价比”的参数->效果增益。

● 因此MiniMind设定small模型dim=512,n_layers=8来获取的「极小体积<->更好效果」的平衡。

● 设定dim=768,n_layers=16来获取效果的更大收益,更加符合小模型Scaling-Law的变化曲线。

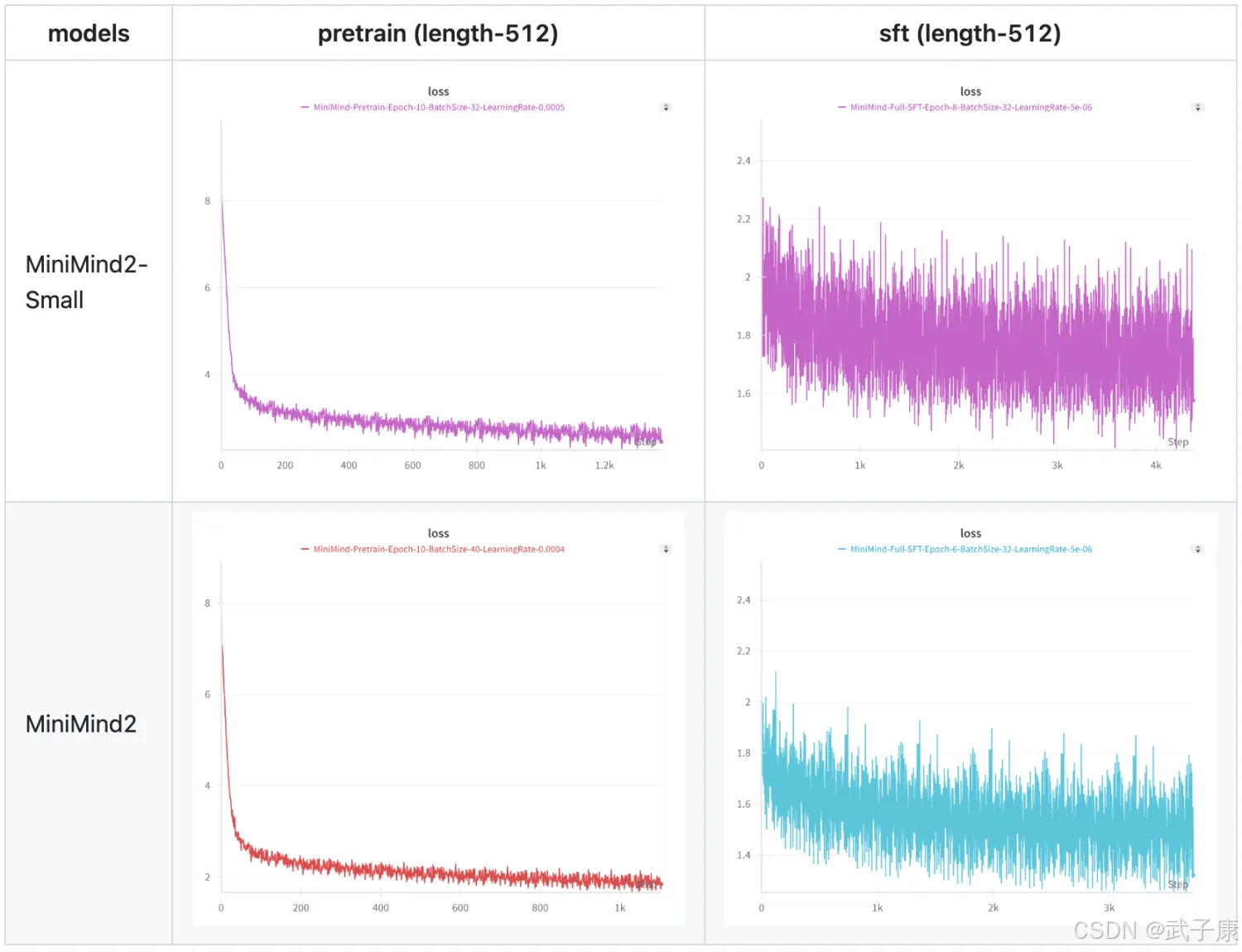

Ⅴ 训练结果

MiniMind2 模型训练损失走势(由于数据集在训练后又更新清洗多次,因此Loss仅供参考)

推荐项目

● https://github.com/meta-llama/llama3

● https://github.com/karpathy/llama2.c

● https://github.com/DLLXW/baby-llama2-chinese

● (DeepSeek-V2)https://arxiv.org/abs/2405.04434

● https://github.com/charent/ChatLM-mini-Chinese

● https://github.com/wdndev/tiny-llm-zh

● (Mistral-MoE)https://arxiv.org/pdf/2401.04088

● https://github.com/Tongjilibo/build_MiniLLM_from_scratch

● https://github.com/jzhang38/TinyLlama

● https://github.com/AI-Study-Han/Zero-Chatgpt

● https://github.com/xusenlinzy/api-for-open-llm

● https://github.com/HqWu-HITCS/Awesome-Chinese-LLM

相关文章:

大语言模型 13 - 从0开始训练GPT 0.25B参数量 MiniMind2 补充 训练开销 训练步骤 知识蒸馏 LoRA等

写在前面 GPT(Generative Pre-trained Transformer)是目前最广泛应用的大语言模型架构之一,其强大的自然语言理解与生成能力背后,是一个庞大而精细的训练流程。本文将从宏观到微观,系统讲解GPT的训练过程,…...

【NLP】37. NLP中的众包

众包的智慧:当“无数人”帮你训练AI 当我们谈论构建大语言模型时,脑海中浮现的往往是服务器、GPU 和Transformer,而很少想到成千上万的普通人也在默默贡献力量。 这背后依赖的机制就是:众包(Crowdsourcing࿰…...

数据分析入门指南:从历史到实践

在信息爆炸的时代,数据分析已经成为各行各业不可或缺的技能,无论是商业决策、医疗研究,还是社会科学,数据分析都在其中扮演着关键角色。本文将带你深入了解数据分析的历史、定义、流程、数据来源与处理、常用工具,并通…...

大语言模型 12 - 从0开始训练GPT 0.25B参数量 MiniMind2 补充 训练开销 训练步骤 知识蒸馏 LoRA等

写在前面 GPT(Generative Pre-trained Transformer)是目前最广泛应用的大语言模型架构之一,其强大的自然语言理解与生成能力背后,是一个庞大而精细的训练流程。本文将从宏观到微观,系统讲解GPT的训练过程,…...

:数据透视表实战与解决方案验证——从问卷分析到产品落地的关键跨越)

精益数据分析(68/126):数据透视表实战与解决方案验证——从问卷分析到产品落地的关键跨越

精益数据分析(68/126):数据透视表实战与解决方案验证——从问卷分析到产品落地的关键跨越 在创业的移情阶段,通过问卷调查获取数据后,如何深入分析数据并验证解决方案的可行性?今天,我们结合《…...

Cursor 模型深度分析:区别、优缺点及适用场景

Cursor 模型深度分析:区别、优缺点及适用场景 在AI辅助编程领域,Cursor凭借其多模型架构和智能上下文感知能力,成为开发者提升效率的核心工具。不同模型在代码生成、逻辑推理、多模态处理等方面存在显著差异,本文将结合技术特性与…...

LightRAG 由入门到精通

LightRAG 由入门到精通 作者:王珂 邮箱:49186456qq.com 文章目录 LightRAG 由入门到精通简介一、LightRAG Server1.1 安装 LightRAG Server1.2 LightRAG Server 和 WebUI1.2.1 配置 LightRAG Server1.2.2 启动 LightRAG Server1.2.3 使用 Docker 加载 …...

【Spring Boot 整合 MongoDB 完整指南】

目录 Spring Boot 整合 MongoDB 完整指南1. 添加依赖2. 配置 MongoDB 连接application.properties 方式:application.yml 方式:3. 创建实体类(映射MongoDB中的文档,相当于MySQL的表)4. 创建 Repository 接口完成简单操作5. 使用 MongoTemplate 进行复杂操作6. 高级配置配置…...

prisma连接非关系型数据库mongodb并简单使用

prisma连接非关系型数据库如mongodb数据库并简单使用 安装 mongodbPrisma连接mongodb改造目录结构写一个model增查查多个查单个分页排序改改多个删单个多个最后代码进度安装 mongodb 社区版下载 副本集模式文档 可以百度下安装副本集模式,因为prisma要用事务。 如果你觉得安装…...

)

深度强化学习 | 基于SAC算法的移动机器人路径跟踪(附Pytorch实现)

目录 0 专栏介绍1 软性演员-评论家SAC算法2 基于SAC算法的路径跟踪2.1 SAC网络设计2.2 动作空间设计2.3 奖励函数设计 3 算法仿真 0 专栏介绍 本专栏以贝尔曼最优方程等数学原理为根基,结合PyTorch框架逐层拆解DRL的核心算法(如DQN、PPO、SAC)逻辑。针对机器人运动…...

VS中将控制台项目编程改为WINDOWS桌面程序

有时候因为误操作,建立了控制台项目,但是实际上想建立桌面程序。那么应该如何改过来呢? 一共要修改两个地方,修改步骤如下: 第一处修改地点: 将C/C下面的预处理器选项中,将原本的_CONSOLE修改…...

从API到UI:直播美颜SDK中的滤镜与贴纸功能开发与落地方案详解

时下,滤镜和贴纸功能,已经成为主播们展现个性、增强互动的“必备神器”。那么,这些功能背后的技术实现到底有多复杂?如何从API到UI构建一个流畅、灵活的美颜SDK呢?本文将从底层原理到前端实现,全面解析这两…...

vue3与springboot交互-前后分离【验证element-ui输入的内容】

系列文章目录 提示:帮帮志会陆续更新非常多的IT技术知识,希望分享的内容对您有用。本章分享的是node.js和vue的使用。前后每一小节的内容是存在的有:学习and理解的关联性。【帮帮志系列文章】:每个知识点,都是写出代码…...

VS2017编译librdkafka 2.1.0

VS2017编译librdkafka 2.1.0 本篇是 Windows系统编译Qt使用的kafka(librdkafka)系列中的其中一篇,编译librdkafka整体步骤大家可以参考: Windows系统编译Qt使用的kafka(librdkafka) 由于项目需要,使用kafka,故自己编译了一次,编译的过程,踩了太多的坑了,特写了本篇…...

DeepSeek 赋能数字孪生:重构虚实共生的智能未来图景

目录 一、数字孪生技术概述1.1 数字孪生的概念1.2 技术原理剖析1.3 应用领域与价值 二、DeepSeek 技术解读2.1 DeepSeek 的技术亮点2.2 与其他模型的对比优势 三、DeepSeek 赋能数字孪生3.1 高精度建模助力3.2 实时数据处理与分析3.3 智能分析与预测 四、实际案例解析4.1 垃圾焚…...

谷歌前CEO TED演讲解析:AI 红利的三年窗口期与行业重构

谷歌前CEO埃里克施密特在2025年TED演讲中提出的"AI红利仅剩3年窗口期"观点,揭示了AI技术从算力、需求到监管的全局性变革。以下是基于演讲内容及关联数据的深度分析: 谷歌前CEO TED演讲解析:AI红利的三年窗口期与行业重构 一、算…...

数据仓库面试题合集②】ETL 设计与调度策略详解

📌 面试官为什么爱问 ETL 与调度? ETL 与调度是数据链路的“输血管道”,它的设计直接决定了数据处理的稳定性、扩展性与时效性。面试中此类问题侧重考察: 数据流设计是否合理 对任务依赖与失败容错的认知 是否具备复杂调度 DAG 设计经验 是否理解增量/全量策略、分区机制…...

前端入职总结

负责的工作内容,遇到的问题,怎么解决, 技能组溢出 问题一:溢入溢出bug 互斥实现的核心逻辑 状态管理: selectedOverflowGroups:存储当前选中的溢出技能组ID(数字字符串数组) sel…...

易境通海外仓系统:一件代发全场景数字化解决方案

随着全球经济一体化和消费升级,一件代发业务的跨境电商市场规模持续增长。然而,一件代发的跨境运营也面临挑战,传统海外仓管理模式更因效率低下、协同困难成为业务扩张的瓶颈。 一、一件代发跨境运营痛点 1、多平台协同:卖家往往…...

C#接口的setter或getter的访问性限制

有时候只想对外提供getter,但是属性的赋值又必须是setter,此时,可以限制setter的访问性。例如,假设有一个自定义字典(MyDict)属性,该属性我只希望外部能够访问,但是设置必须在内部,则可提供如下…...

)

云计算与大数据进阶 | 26、解锁云架构核心:深度解析可扩展数据库的5大策略与挑战(下)

在数据库的世界里,面对数据如潮水般的增长难题,聪明的工程师早已准备了五大扩展方案来应对,它们就像五把钥匙,以破解着不同场景下的性能困局。 上回书云计算与大数据进阶 | 26、解锁云架构核心:深度解析可扩展数据库的…...

SID 2025上的天马,用“好屏”技术重构产业叙事

作为全球最具影响力的显示行业盛会,SID国际显示周不仅是技术比拼的舞台,更是未来产业方向的风向标。SID 2025上的技术密度与产业动态,再一次验证了这一定律。 Micro-LED、柔性OLED、裸眼3D、量子点、透明显示等新技术在SID 2025集中亮相&…...

深入理解 Hadoop 核心组件 Yarn:架构、配置与实战

一、Hadoop 三大件概述 Hadoop 作为大数据领域的基石,其核心由三大组件构成: HDFS(分布式文件系统):负责海量数据的分布式存储,通过数据分块和副本机制保障可靠性,是大数据存储的基础设施。 …...

)

Linux云计算训练营笔记day11(Linux CentOS7)

Linux云计算 云计算是一种服务,是通过互联网按需提供计算资源的服务模式 程序员写代码的,部署上线项目 买服务器(一台24小时不关机的电脑,为客户端提供服务) 20万 买更多的服务器 Linux(命令) windows(图形化) 就业岗位: 云计算工程师 li…...

2025年AI与网络安全的终极博弈:冲击、重构与生存法则

引言 2025年,生成式AI的推理速度突破每秒千万次,网络安全行业正经历前所未有的范式革命。攻击者用AI批量生成恶意代码,防御者用AI构建智能护盾,这场技术军备竞赛正重塑行业规则——60%的传统安全岗位面临转型,70%的防…...

Hadoop中 8020、9000、50070 端口用途的详细对比

Hadoop 端口用途对比教程 1. 端口用途总览 Hadoop 的核心服务(如 NameNode、DataNode、ResourceManager 等)通过不同的端口对外提供服务。不同版本中,部分端口号可能发生变化,尤其是 Hadoop 3.x 对部分默认端口进行了调整。 端口Hadoop 2.x (2.7.7)Hadoop 3.x (3.1.3)协议…...

HLS学习

文章目录 前言一、hls是什么二、m3u8文件格式说明 前言 在工作,需要跟m3u8的格式进行打交道,所以就去学习了一些相关的内容。本文是相关的笔记。 一、hls是什么 HTTP Live Streaming,缩写为HLS,是由苹果公司提出基于HTTP的流媒体…...

【Linux系统】Linux入门系统程序−进度条

文章目录 一、铺垫知识1.回车符 和 换行符的区别2.用户缓冲区问题 二、进度条程序初版(含视频演示效果)三、进度条程序(加入使用场景) 一、铺垫知识 1.回车符 和 换行符的区别 回车符’\r’ 的效果(让光标回到当前行开头) 和 换…...

Java大师成长计划之第27天:RESTful API设计与实现

📢 友情提示: 本文由银河易创AI(https://ai.eaigx.com)平台gpt-4-turbo模型辅助创作完成,旨在提供灵感参考与技术分享,文中关键数据、代码与结论建议通过官方渠道验证。 在现代软件架构中,RESTf…...

SEO长尾词与关键词优化策略

内容概要 在搜索引擎优化(SEO)实践中,长尾关键词与核心关键词的协同布局是提升网站可见性与流量的核心路径。本文系统性阐述从基础策略到高阶技术的全链路优化方案,重点剖析长尾关键词的挖掘逻辑与筛选标准,建立基于搜…...

Linux-进程信号

1.快速认识信号 1.1生活角度的信号 你在⽹上买了很多件商品,再等待不同商品快递的到来。但即便快递没有到来,你也知道快递来临 时,你该怎么处理快递。也就是你能“识别快递” 当快递员到了你楼下,你也收到快递到来的通知&#…...

Trae生成 django5.2.1后台管理

安装django,采用的是5.2.1版本: pip install django Trae对话框中输入: 基于django框架,生成版本管理功能,版本管理模块命名为versions,工程项目命名为main 迁移数据库: python manage.py …...

Interrupt 2025 大会回顾:关于LangChain 的 AI Agent会议内容总结

Interrupt 2025 大会已圆满落下帷幕!今年,来自全球各地的 800 多位人士齐聚旧金山,参加了 LangChain 首次举办的行业盛会,共同聆听各团队分享构建 AI Agent 的经验故事——会议的精彩和余温至今仍令人振奋! 思科、优步…...

C#学习9——接口、抽象类

一、接口 1.什么是接口 官方话:是一种定义契约(一组方法、属性、事件或索引器的抽象声明)的机制,它规定了实现该接口的类或结构必须提供这些成员的具体实现。接口是面向对象编程中实现多态和抽象的重要工具。 个人理解…...

【高德开放平台-注册安全分析报告】

前言 由于网站注册入口容易被黑客攻击,存在如下安全问题: 暴力破解密码,造成用户信息泄露短信盗刷的安全问题,影响业务及导致用户投诉带来经济损失,尤其是后付费客户,风险巨大,造成亏损无底洞…...

Xshell实战:远程连接VMware CentOS7虚拟机与高效运维指南——从零配置到自动化操作,解锁Xshell的核心价值

一、实战背景与目标 在开发与运维工作中,常需通过本地Windows主机远程管理虚拟机中的Linux系统。Xshell作为专业终端工具,能快速建立安全连接,执行高效操作。 场景需求: 在Windows系统中,通过Xshell远程连接VMware中的…...

C#编写软件添加菜单栏

将MenuStrip控件拖动到窗体,可以直接在工具箱搜索menu,我是先在窗体上上加了一个panel,把MenuStrip拖动到panel上面,点击即可输入自己需要的文本。...

【C++】map和multimap的常用接口详解

map和multimap的文档:<map> - C Reference 1.map类的介绍 map 有两个模板参数,是 key/value的场景。 这里的Key就是key,T就是value,命名不同而已。map默认要求Key⽀持⼩于⽐较(升序),如…...

线程池模式与C#中用法

一、线程池模式解析 1. 核心概念 线程池是一种 管理线程生命周期的技术,主要解决以下问题: 减少线程创建/销毁开销:复用已存在的线程 控制并发度:避免无限制创建线程导致资源耗尽 任务队列:有序处理异步请求 2. …...

47、C#可否对内存进⾏直接的操作?

是的,C# 可以通过几种方式对内存进行直接操作,尽管它主要是一门托管语言,内存管理通常由.NET运行时自动处理。 主要方法 1.unsafe 代码和指针 使用 unsafe 关键字可以启用指针操作需要项目启用"允许不安全代码"选项示例…...

:MVP迭代中的数据驱动决策与功能取舍)

精益数据分析(70/126):MVP迭代中的数据驱动决策与功能取舍

精益数据分析(70/126):MVP迭代中的数据驱动决策与功能取舍 在创业过程中,最小可行化产品(MVP)的迭代优化是从验证假设到实现产品市场契合的关键环节。今天,我们结合《精益数据分析》中的方法论…...

大数据与数据库服务器参数调优方法

1 硬件配置优化 存储与磁盘 优先选择 SSD固态硬盘替代机械硬盘,显著降低I/O延迟,提升随机读写性能。 采用 RAID 10阵列实现高性能与冗余的平衡,适用于高并发数据库场景。 大数据场景中,通过多磁盘并行挂载(如HDFS)提升吞吐量,规避单盘性能瓶颈。 I/…...

【Fifty Project - D28】

今日完成记录 TimePlan完成情况9:30 - 11:30Leetcode√14:00 - 15:30练胸√15:30 - 16:30Leetcode√19:40 - 21:20有氧√ Leetcode 今天是周赛复盘篇,昨天的周赛太刺激…...

Image and depth from a conventional camera with a coded aperture论文阅读

Image and depth from a conventional camera with a coded aperture 1. 研究目标与实际意义1.1 研究目标1.2 实际问题与产业意义2. 创新方法:编码光圈设计与统计模型2.1 核心思路2.2 关键公式与模型架构2.2.1 图像形成模型2.2.2 深度可区分性准则2.2.3 统计模型与优化框架2.2…...

vue3 vite 项目中自动导入图片

vue3 vite 项目中自动导入图片 安装插件配置插件使用方法 安装插件 yarn add vite-plugin-vue-images -D 或者 npm install vite-plugin-vue-images -D配置插件 在 vite.config.js 文件中配置插件 // 引入 import ViteImages from vite-plugin-vue-images;plugins: [vue(),/…...

软考-软件工程开发模型

软考-软件工程开发模型 参考视频: 软件工程概述&开发模型 ,配合视频理解更清晰~ 软件的生命周期为:需求分析、软件设计、软件开发、运行维护直至被淘汰 几个阶段。 软件工程支持 4 个活动,简称 PDCA,…...

纸上流年:Linux基础IO的文件理解与操作

文章目录 前言:数字世界的窗口🌇序章🏙️正文一、文件理解二、C语言文件操作2.1、文件打开2.2、文件关闭2.3、文件写入2.4、文件读取 三、系统级文件操作3.1、打开 open3.1.1、函数理解 3.2、关闭 close3.3、写入 write3.4、读取 read 四、小…...

基础深度补全模型DepthLab: From Partial to Complete

许多任务本身就包含部分深度信息,例如:(1)三维高斯图像修复;(2)激光雷达深度补全;(3)利用 Dust3R 进行稀疏视角重建;以及(4࿰…...

15 秒写一首歌?AI 音乐生成模型 ACE-Step 上手体验!

在人工智能技术持续突破的浪潮中,音乐创作领域迎来了革命性的变革。近日,阶跃星辰与ACE Studio联合发布的开源音乐大模型ACE-Step(中文名:音跃)正式亮相,标志着AI音乐创作技术迈入全新阶段。这款集成了最新…...

如何在数据库中正确存储金额?

无论是开发电商平台、财务系统还是支付应用,金额的存储都是核心需求。但许多新手开发者常因字段类型选择不当,导致金额计算错误甚至资金损失。本文将用最通俗的语言,详细讲解如何专业地设计数据库中的金额字段。 一、为什么不能随便选字段类型…...